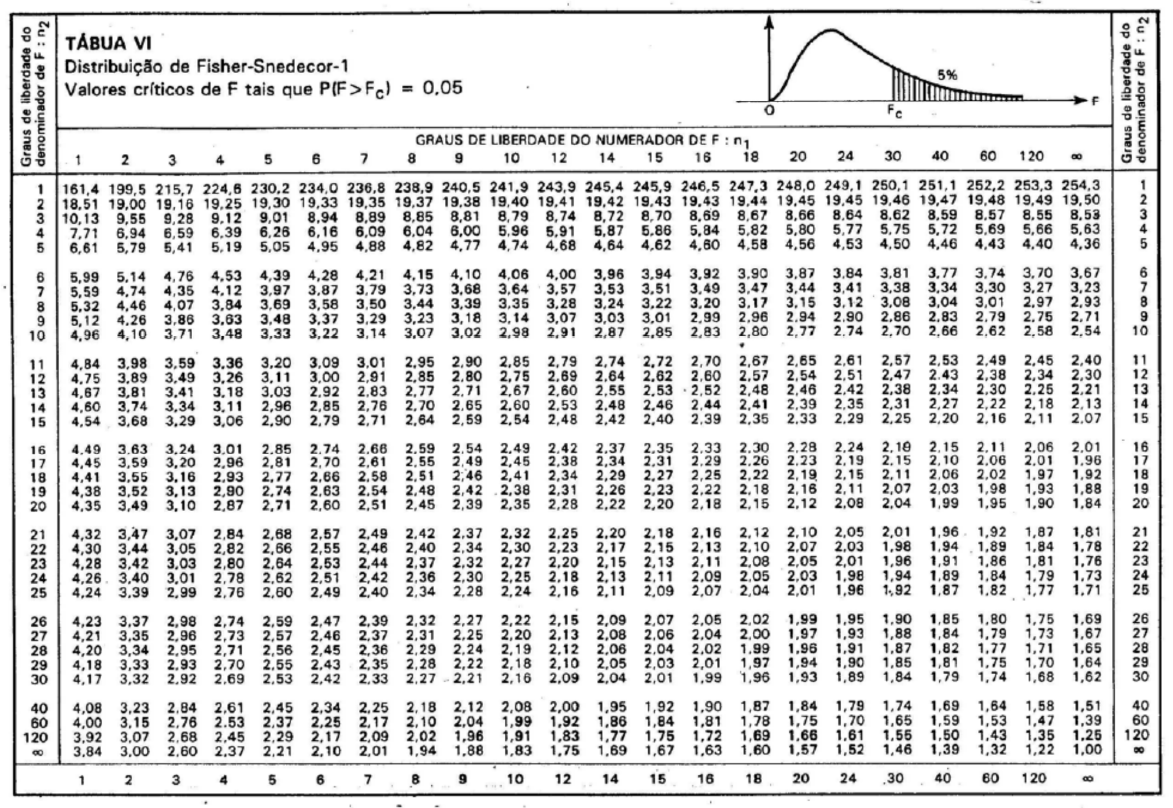

class: center, middle, inverse, title-slide .title[ # Estatística e Informática ] .subtitle[ ## Aula 12 - Comparação de Parâmetros ] .author[ ### Alan Rodrigo Panosso <a href="mailto:alan.panosso@unesp.br" class="email">alan.panosso@unesp.br</a> ] .institute[ ### Departamento de Engenharia e Ciências Exatas FCAV/UNESP ] .date[ ### (06-06-2024) ] --- class: middle, center, inverse # Comparações de parâmetros de duas populações --- Suponha duas amostras aleatórias independentes de tamanhos `\(n_1\)` e `\(n_2\)` ou seja, `\(X_1 , X_2 , ..., X_{n1}\)` e `\(Y_1 ,Y_2 , ...,Y_{n2}\)`, respectivamente, de uma população com distribuição `\(N(\mu_1, \sigma_1^2)\)` e de população com distribuição `\(N(\mu_2, \sigma_2^2)\)` ### Hipóteses `\(H_0: \sigma_1^2 = \sigma_2^2\)` ou seja `\(\left(\frac{\sigma_1^2}{\sigma_2^2} = 1 \right)\)` `\(H_1: \sigma_1^2 \neq \sigma_2^2\)` ou seja `\(\left(\frac{\sigma_1^2}{\sigma_2^2} \neq 1 \right)\)` --- ### Estatística do teste: Sendo `\(s_1^2\)` e `\(s_2^2\)` as variâncias, respectivamente das amostras `\(n_1\)` e `\(n_2\)`, o quociente `$$\frac{s^2_1 / \sigma_1^2}{ s^2_2 / \sigma^2_2}$$` Segue a distribuição de `\(F\)` (Snedecor) com `\(n_1-1\)` e `\(n_2-1\)` graus de liberdade `\((GL)\)`, tem a denotação `\(F(n_1-1, n_2-1)\)`. Sob a suposição de `\(H_0\)` ser verdadeira, isto é, `\(\sigma^2_1 = \sigma^2_2\)`, tem-se que `\(F = \frac{s^2_1}{s^2_2} \sim F(n_1-1, n_2-1)\)` --- #### Construção da região crítica Fixado `\(\alpha\)`, os pontos críticos serão `\(F_1\)` e `\(F_2\)` da distribuição `\(F\)`, tais que: <img src="https://raw.githubusercontent.com/arpanosso/estatinfo/master/slides/img/testeH_17.png" width="80%" style="display: block; margin: auto;" /> Se `\(\alpha = 10\%\)`, pode-se, utilizando a Tabela da distribuição `\(F\)`, encontrar diretamente `\(F_2(5\%)\)`. Para encontrar `\(F_1(95\%)\)` utiliza-se a propriedade: `\(F_{(1-\alpha;\;n_1-1,\; n_2-1)} = \frac{1}{F_{(\alpha;\;n_2-1,\; n_1-1)}}\)`, assim: `\(F_{(0,95;\;n_1-1,\; n_2-1)} = \frac{1}{F_{(0,05;\;n_2-1,\; n_1-1)}}\)` --- #### Exemplo: Construir a regição crítica para o caso abaixo: Se `\(n_1 - 1= 5\)` e `\(n_2-1 = 7\)` dado `\(\alpha = 10\%\)` `\(F2_{(0,05;\;5,\; 7)} = 3,97\)` olhamos na tabela --- [Tabela - Distribuição F-Snedecor](https://github.com/arpanosso/estatinfo/raw/master/docs/TabelaFSnedecor.pdf)  --- F1 precisamos calcular: `\(F1_{(0,95;\;5,\; 7)} = \frac{1}{F_{(0,05;\;7,\; 5)}}=\frac{1}{4,88} = 0,205\)` Assim, `\(RC = \{0 < F < 0,205 \text{ ou } F > 3,97 \}\)` --- Entretanto, o procedimento que se usa na prática é calcular `\(F\)` utilizando sempre a maior variância no numerador `\(s_1^2 > s^2_2\)` portanto `\(F > 1\)`, e considerar o ponto crítico `\(F_{2(\alpha;\;n1-1,\; n2-1)}\)`. **Amostra:** Colhidas amostras aleatórias `\(n_1\)` e `\(n_2\)`, calcula-se `\(s^2_1\)` e `\(s^2_2\)` com `\((s^2_1 > s^2_2)\)`, então: `$$F_{obs} = \frac{s^2_1}{s^2_2} \sim F_{(n_1-1;n_2-1)}$$` **Conclusão:** Se `\(F_{obs} \in RC\)`, **rejeita-se** `\(H_0\)`, no caso contrário, **não se rejeita** `\(H_0\)`. --- **Exemplo**. Dois grupo de `\(8\)` animais da mesma idade e raças diferentes foram submetidos a um mesmo regime alimentar. Os resultados para ganho de peso foram: | | | | | | | | ---| ---|--- | ---| ---|--- |--- |--- | **R1:** | `\(2,30\)` | `\(2,10\)` | `\(1,91\)` | `\(1,20\)` | `\(1,93\)` | `\(1,88\)` | `\(1,95\)` | `\(2,10\)` **R2:** | `\(2,30\)` | `\(2,15\)` | `\(2,00\)` | `\(1,28\)` | `\(2,15\)` | `\(2,20\)` | `\(1,91\)` | `\(2,06\)` Ao nível de `\(5\%\)`, as variâncias dos ganhos de pesos raças diferem entre si? --- ```r r1<-c(2.30,2.10,1.91,1.20,1.93,1.88,1.95,2.10) r2<-c(2.30,2.15,2.00,1.28,2.15,2.20,1.91,2.06) var.test(r1,r2) ``` ``` #> #> F test to compare two variances #> #> data: r1 and r2 #> F = 1.0362, num df = 7, denom df = 7, p-value = 0.9638 #> alternative hypothesis: true ratio of variances is not equal to 1 #> 95 percent confidence interval: #> 0.2074474 5.1756306 #> sample estimates: #> ratio of variances #> 1.036181 ``` --- Testar as hipóteses: $$ `\begin{cases} H_0: \sigma_{r1}^2 = \sigma_{r2}^2 \\ H_1: \sigma_{r1}^2 \neq \sigma_{r2}^2 \end{cases}` $$ Calculando os valores de variância para as duas raças: `\(s_{r1}^2 = 0,10433\)` e `\(s_{r2}^2 = 0,10068\)` sendo que `\(n_{r1} = n_{r2} = 8\)` e `\(\alpha = 5\%\)` A estatística do teste: `\(\frac{s_{r1}^2}{s_{r2}^2} = \frac{0,10433}{0,10068} = 1,03618\)` --- `\(F_{c(0,05; 7, 7)} = 3,79\)` assim, `\(RC = \{ F > 3,79 \}\)` <img src="Aula12_files/figure-html/unnamed-chunk-3-1.png" style="display: block; margin: auto;" /> Como `\(F_{obs} \notin RC\)` não se rejeita `\(H_0\)`, ou seja, as variâncias são estatisticamente iguais ao nível de 5% de significância, ou seja, as variâncias dos ganhos de peso das raças são homocedásticas. --- ### Comparação de duas médias de populações normais: amostras independentes A análise da hipótese da igualdade de variâncias é crucial para o uso do teste *t*, na comparação de duas médias, apresentado a seguir. Com o objetivo de se comparar duas populações examinaremos a situação na qual os dados estão na forma de realizações de amostras aleatórias de tamanhos `\(n_1\)` e `\(n_2\)`, selecionadas, respectivamente, das populações `\(1\)` e `\(2\)`. Uma coleção de `\(n_1 + n_2\)` elementos são aleatoriamente divididos em `\(2\)` grupos de tamanhos `\(n_1\)` e `\(n_2\)`, onde cada membro do primeiro grupo recebe o tratamento `\(1\)` e do segundo, o tratamento `\(2\)`. Especificamente, estaremos interessados em fazer inferência sobre o parâmetro: `\(\mu_1 - \mu_2\)` = (média da população 1) – (média da população 2) **Hipótese:** `\(H_0: \mu_1 = \mu_2\)` ou seja, `\(\mu_1 - \mu_2 = 0\)` **Estatística do teste:** `\(Z = \frac{(\bar{X}-\bar{Y})-(\mu_1-\mu_2)}{\sqrt{\frac{\sigma^2_1}{n_1} + \frac{\sigma^2_2}{n_2}}} \sim N(0,1)\)` --- #### Caso 1: variâncias conhecidas `\(Z = \frac{(\bar{X}-\bar{Y})}{\sqrt{\frac{\sigma^2_1}{n_1} + \frac{\sigma^2_2}{n_2}}} \sim N(0,1)\)` #### Caso 2: variâncias desconhecidas e iguais Preliminarmente, testa-se se as variâncias das duas populações são iguais. Caso a hipótese não seja rejeitada, isto é, que `\(\sigma_1^2=\sigma_2^2=\sigma^2\)`, a estatística anterior transforma-se em: `\(Z = \frac{(\bar{X}-\bar{Y})}{\sigma\sqrt{\frac{1}{n_1} + \frac{1}{n_2}}}\)` , substituimos `\(\sigma\)` por um estimador, teremos uma expressão muito semelhante à `\(t\)` de Student. Uma estatística para `\(\sigma^2\)` é a média ponderada: `\(S_P^2 = \frac{(n_1-1)s_1^2+(n_2-1)s^2_2}{(n_1-1)+(n_2-1)}\)` que, como `\(s^2_1\)` e `\(s^2_2\)` são dois estimadores não viciados de `\(\sigma^2\)`, também é um estimador não viciado de `\(\sigma^2\)`. Assim, `\(t = \frac{(\bar{X} - \bar{Y})}{s_p\sqrt{\frac{1}{n_1}+\frac{1}{n_2}}} \sim t(n_1+n_2 - 2) GL\)` --- **Exemplo**. Dois grupo de `\(8\)` animais da mesma idade e raças diferentes foram submetidos a um mesmo regime alimentar. Os resultados para ganho de peso foram: | | | | | | | | ---| ---|--- | ---| ---|--- |--- |--- | **R1:** | `\(2,30\)` | `\(2,10\)` | `\(1,91\)` | `\(1,20\)` | `\(1,93\)` | `\(1,88\)` | `\(1,95\)` | `\(2,10\)` **R2:** | `\(2,30\)` | `\(2,15\)` | `\(2,00\)` | `\(1,28\)` | `\(2,15\)` | `\(2,20\)` | `\(1,91\)` | `\(2,06\)` Ao nível de `\(5\%\)`, as médias dos ganhos de pesos raças diferem entre si? --- ```r r1<-c(2.30,2.10,1.91,1.20,1.93,1.88,1.95,2.10) r2<-c(2.30,2.15,2.00,1.28,2.15,2.20,1.91,2.06) t.test(r1, r2, alternative = "le", var.equal = TRUE) ``` ``` #> #> Two Sample t-test #> #> data: r1 and r2 #> t = -0.53098, df = 14, p-value = 0.3019 #> alternative hypothesis: true difference in means is less than 0 #> 95 percent confidence interval: #> -Inf 0.1969546 #> sample estimates: #> mean of x mean of y #> 1.92125 2.00625 ``` --- Usando os dados do exemplo anterior, testar se há evidência de que as duas raças apresentam o mesmo ganho de peso `\((H_0: \mu_A = \mu_B \text{ vs. } H_1: \mu_A < \mu_B)\)`, ao nível de `\(5\%\)`. $$ `\begin{cases} H_0: \mu_{r1} = \mu_{r2} \\ H_1: \mu_{r1} < \mu_{r2} \end{cases}` $$ Calculando os valores de média e desvio-padrão: `\(\bar{X} = 1,92125\)` e `\(s_{r1}^2 = 0,10433\)` e `\(\bar{Y} = 2,00625\)` e `\(s_{r2}^2 = 0,10068\)` sendo que `\(n_{r1} = n_{r2} = 8\)` e `\(\alpha = 5\%\)` Assim, `\(S_P^2 = \frac{(n_1-1)s_1^2+(n_2-1)s^2_2}{(n_1-1)+(n_2-1)} = \frac{(8-1)0,10433+(8-1)0,10068}{(8-1)+(8-1)} = 0,1025054\)` sendo `\(S_P = 0,3201646\)` Portanto, `\(t_{obs} = \frac{(\bar{X} - \bar{Y})}{s_p\sqrt{\frac{1}{n_1}+\frac{1}{n_2}}} = \frac{(1,92125 - 2,00625)}{0,3201646\sqrt{\frac{1}{8}+\frac{1}{8}}} = -0,5309908\)` --- <img src="https://raw.githubusercontent.com/arpanosso/estatinfo/master/slides/img/ic_05.png" width="100%" style="display: block; margin: auto;" /> Para a construção da **região crítica** do teste: `\(t_c(14; 0,05) = -1,761\)` assim, a região crítica é `\(RC = \{ t \le -1,76131\}\)` --- **Conclusão**: Como `\(t_{obs} \notin RC\)`, não rejeita-se `\(H_0\)`, não há evidências de que a raça 1 apresenta maior ganho de peso que a raça 2. <img src="Aula12_files/figure-html/unnamed-chunk-6-1.png" style="display: block; margin: auto;" /> --- #### Caso 3: variâncias desconhecidas e desiguais (Teste de Smith – Satterthwaite) Quando a hipótese de igualdade de variâncias for rejeitada, deve-se substituir `\(\sigma^2_1\)` e `\(\sigma^2_2\)` pelos seus respectivos estimadores `\(s^2_1\)` e `\(s^2_2\)` obtendo a estatística: `$$t = \frac{(\bar{X}-\bar{Y})}{\sqrt{\frac{s^2_1}{n_1}+\frac{s^2_2}{n_2}}}$$` que sob a veracidade de `\(H_0\)` `\((\mu_1 - \mu_2 = 0)\)`, aproxima-se de uma distribuição `\(t\)` de Student, com número de graus de liberdade dado aproximadamente por: `$$gl=\frac{\frac{s^2_1}{n_1} + \frac{s^2_2}{n_2}}{\frac{\left( \frac{s^2_1}{n_1} \right)^2}{n_1-1}+\frac{\left( \frac{s^2_2}{n_2} \right)^2}{n_2-1}}$$` --- Como o número de graus de liberdade assim calculado, geralmente, é **não inteiro**, recomenda-se aproximá-lo para o inteiro imediatamente anterior a este. Se `\(n_1\)` e `\(n_2\)` são ambos grandes `\((n \ge 30)\)`, o teste pode ser baseado na estatística. `$$Z = \frac{(\bar{X}-\bar{Y})-(\mu_1-\mu_2)}{\sqrt{\frac{s^2_1}{n_1}+\frac{s^2_2}{n_2}}} \sim N(0,1) \text{ sob } H_0$$` pois permanece válido se `\(\sigma^2_1\)` e `\(\sigma^2_2\)` são substituídos por seus respectivos estimadores amostrais `\(s^2_1\)` e `\(s^2_2\)`. **Nota**: no caso da inferência originada de amostras grandes, não é necessário assumir que as distribuições das populações originais são normais, porque o teorema central do limite garante que as médias amostrais X e Y são aproximadamente distribuídas como `\(N( \mu_1, \sigma^2 / n_1 )\)` e `\(N( \mu_2, \sigma^2 / n_2 )\)`, respectivamente. Além disso, a suposição de variâncias populacionais iguais `\((\sigma^2_1 = \sigma^2_2)\)` que é usada para amostras pequenas, é evitada nessa situação.